El 9 de setiembre se publicó del Reglamento de la Ley 31814 (Ley de Inteligencia Artificial del Perú) por el Decreto Supremo N.º 115-2025-PCM, estableciendo las disposiciones para el uso seguro y ético de la inteligencia artificial (IA) en el país. Sus principales disposiciones incluyen principios rectores (como no discriminación, privacidad y transparencia), una clasificación de riesgos para los sistemas de IA y prohibiciones en usos indebidos.

El reglamento, que entrará en vigor el 22 de enero de 2026, fue analizado y comentado por expertos internacionales en el webinar eBIZ Campus «La hoja de ruta jurídica de la IA en el Perú: Ley 31814 y su reglamento» de eBIZ. Anais Zavala, experta en regulación de Seguridad y Confianza Digital de la Secretaría de Gobierno y Transformación Digital (SGTD) expuso los alcances de la norma.

En el panel participaron destacados expertos internacionales: desde México, Luis Gonzáles, fundador y director ejecutivo de Club IA Legal, la comunidad que impulsa el uso ético e innovador de la IA en el derecho hispanohablante; desde Chile, Esteban Ruiz, director ejecutivo de la Asociación Gremial de Legaltech Chile (Altech); y Fátima Toche, gerente legal de Iriarte & Asociados (IALaw). La moderación estuvo a cargo del Dr. Erick Iriarte, CEO de eBIZ.

¿Qué implica el Reglamento?

Anais Zavala resaltó en su presentación que el Reglamento busca equilibrar la promoción de la innovación tecnológica con la protección de los derechos humanos, considerando los riesgos y vulneraciones que puede generar la IA. Por eso se incorpora principios como supervisión humana, transparencia, rendición de cuentas, privacidad de datos y sostenibilidad, alineados con recomendaciones internacionales como las de la Unesco.

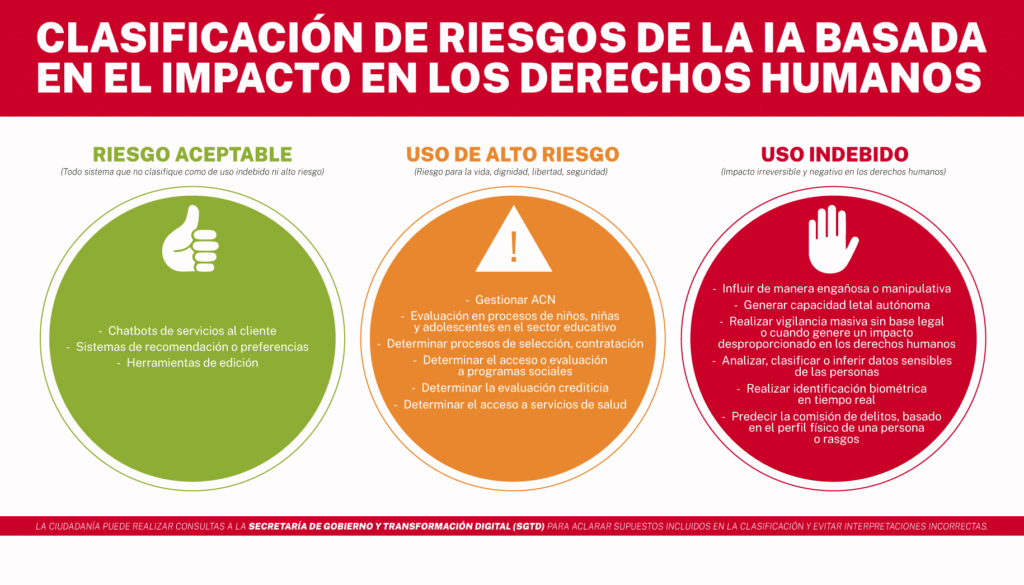

La norma establece tres niveles de riesgo para los sistemas de IA: prohíbe el uso indebido en el caso de impacto irreversible en derechos humanos, como su uso en armas de guerra o vigilancia masiva. Además, se establece el riesgo alto que debe ser controlado por posibles daños significativos, pero reparables, y un riesgo aceptable, de menor impacto, que implica cumplir con ciertas obligaciones.

Con este reglamento, explicó, las empresas deberán cumplir con principios como transparencia, supervisión humana, protección de los derechos humanos, rendición de cuentas, privacidad de datos y sostenibilidad en el desarrollo y uso de la IA. Tendrán que identificar el nivel de riesgo de sus sistemas de IA y aplicar controles proporcionales. Los sistemas de riesgo alto, por ejemplo, requerirán supervisión humana, transparencia algorítmica y evaluaciones de impacto. Además, deberán informar a los usuarios cuando interactúan con sistemas de IA y mantener registros actualizados sobre su lógica algorítmica.

El Reglamento busca equilibrar la promoción de la innovación tecnológica con la protección de los derechos humanos, considerando los riesgos y vulneraciones que puede generar la IA. Por eso se incorpora principios como supervisión humana, transparencia, rendición de cuentas, privacidad de datos y sostenibilidad.

Anais Zavala aclaró que, para el sector público, se establecen algunas obligaciones de uso ético y responsable, incluyendo la publicación de datos y código fuente junto a la adopción de estándares internacionales y la protección de datos personales desde el diseño. La entrada en vigor será progresiva, según el tipo de entidad: arrancan el Poder Ejecutivo, Legislativo y Judicial en 2026; luego, en el 2027, los gobiernos regionales, universidades y otras empresas públicas; y al final los gobiernos locales, que tienen entre 2027 y 2028.

Para el sector privado incluye obligaciones proporcionales al nivel de riesgo, alfabetización digital, mecanismos de supervisión y transparencia algorítmica. El plazo más amplio es para las microempresas que facturan hasta 150 UIT (alrededor de S/ 750 mil), quienes tendrán hasta el 2028. La implementación para aquellas pequeñas empresas que tengan ingresos anuales hasta 1 700 UIT (más de S/ 8,5 millones) será hasta el 2027. Además, se medirá la adopción de las obligaciones según el sector, dando, por ejemplo, un año a quienes trabajan en salud, justicia y seguridad o economía, y dos para los que están en transporte, comercio y producción.

Será obligatorio implementar medidas técnicas y organizativas para garantizar la privacidad y seguridad de los datos personales, desde la etapa de diseño de los sistemas de IA. También se contemplan excepciones, como por ejemplo algunos usos de la autenticación biométrica. En caso de incumplimiento, la SGTD no tiene capacidad sancionadora, pero sí puede recoger la denuncia y derivarla a la autoridad competente, ya sea la ANPD, Contraloría o Indecopi. «Hemos buscado los mecanismos alternativos que ya existen en el Estado peruano y aquellas entidades que sí cuentan con las competencias sancionadoras para que exista, de alguna manera, una protección efectiva de estos derechos», mencionó.

«Todo esto se desarrolló en el marco del sistema nacional de transformación digital. Nosotros debemos tener en cuenta que esta normativa de IA no se puede leer de una manera separada de todo el marco que ya tenemos en el ecosistema digital, sino que tenemos que hacer una interpretación sistemática».

Anais Zavala, experta en regulación de Seguridad y Confianza Digital de la Secretaría de Gobierno y Transformación Digital (SGTD)

En relación con la Gobernanza Digital, comentó que la norma busca fortalecerla. En los índices de Oxford Inside, el Perú había retrocedido dos posiciones en comparación con el 2023, debido a una falta de mecanismos para la gobernanza y la falta de reglas claras acerca de la transparencia, la capacitación y otros aspectos claves, dijo. Ante ello, se ha buscado fortalecerla con la inclusión de nuevos actores.

Se propone la reactivación del Comité de alto nivel por un Perú digital innovador y competitivo, creado en 2018 pero desactivado luego. Este comité es un órgano estratégico que incluye representantes del sector privado y la academia. Además, tienen los comités de gobiernos de transformación digital y los oficiales de datos, que cumplen una acción estratégica dentro de sus organizaciones.

Referente para la región

El Perú marca un precedente en la región al establecer obligaciones, plazos y estándares para el desarrollo y uso de la inteligencia artificial (IA), siendo una de las primeras leyes de IA en el mundo, remarcó Anais Zavala en su presentación. La Ley fue publicada en 2023 y para elaborar el Reglamento, indicó, se tuvo un proceso de elaboración participativo, incluyendo aportes de la academia, sociedad civil, sector privado y entidades públicas. Se publicaron dos borradores: una en mayo del 2024 y otra en noviembre. Además de hacer la consulta pública digital, también se hizo una presencial y se establecieron mesas de trabajo. Recibieron más de 2 300 comentarios en la consulta pública, de los cuales se acogieron total o parcialmente la mayoría, remarcó.

«Me consta la apertura que han tenido para discutir el reglamento. He estado en todas las mesas de trabajo y enviado comentarios en todas las convocatorias. He podido ver que nos han abierto las puertas al sector público, sociedad civil y academia, algo que no es común y que esperamos se repita para otras normas», comentó Fátima Toche, de IALaw.

«Todo esto se desarrolló en el marco del sistema nacional de transformación digital. Nosotros debemos tener en cuenta que esta normativa de IA no se puede leer de una manera separada de todo el marco que ya tenemos en el ecosistema digital, sino que tenemos que hacer una interpretación sistemática», dijo Anais Zavala.

«Tenemos que ser bien críticos a la hora de definir qué buscamos con la regulación. No hay manera de que esto no se regule, pero que sea adecuado a nuestra realidad».

Luis Gonzáles, fundador y director ejecutivo de Club IA Legal

La inteligencia artificial puede ser fundamental para países en desarrollo si se utiliza con ese enfoque de impulsar el desarrollo humano, social y la competitividad, añadió Fátima Toche (IALaw). Es importante que nuestras regulaciones respondan al contexto geopolítico, dijo, y continuar con el diálogo que ha existido en la elaboración de este reglamento, apuntó.

Esteban Ruiz (Altech), comentó a su turno que un Estado democrático debe respetar los derechos humanos, los cuales pueden estar en riesgo con los sistemas de inteligencia, por tanto, es inevitable tener una regulación. Sin embargo, remarcó que es fundamental evitar la sobrerregulación, ya que podría limitar la innovación tecnológica y causar la fuga de startups. No se debe solo copiar lo que hace Europa, dijo, donde ya se está debatiendo si el modelo regulatorio es adecuado. «Los sistemas deben ser flexibles, para adaptarlos a la realidad diaria. Entonces, es importante encontrar un equilibrio entre proteger derechos y fomentar el desarrollo tecnológico», remarcó.

Luis Gonzáles (Club IA Legal) coincidió en la necesidad de una legislación especial para a IA, que ya es de uso cotidiano y evoluciona constantemente. La falta de certeza jurídica crea incertidumbre sobre las responsabilidades por asumir, por lo tanto, es necesaria una regulación, pero no se trata de copiar tal cual el modelo de la Unión Europea, que también considero muy restrictivo y poco adecuado para América Latina. El modelo por seguir ha de ser lo que se está trabajando en la región, en Perú, por ejemplo, y crear algo acorde a esta realidad latinoamericana, comentó.

«Lo importante es no perder de vista que esto es una herramienta y todas las herramientas son creadas por humanos, siempre (…) No olvidarlo nunca: la regulación es creada por humanos para evitar lo que los humanos puedan hacer mal al usar las máquinas».

Erick Iriarte, CEO de eBIZ

«Debemos unir esfuerzos para tener una mirada común en la región. Es fundamental analizar qué esperamos lograr con la IA y cómo queremos desarrollarla en áreas como la economía y la educación. Tenemos que ser bien críticos a la hora de definir qué buscamos con la regulación. No hay manera de que esto no se regule, pero que sea adecuado a nuestra realidad», remarcó Gonzáles.

«Definitivamente no hemos buscado un enfoque restrictivo, como el que existe en la Unión Europea, sino más bien hemos buscado un enfoque que sea equilibrado, sin perder de vista la experiencia, pues internacional», aclaró Anais Zavala, quien también coincidió en la necesidad de tener reglas que se adecuen a nuestra cultura y al trabajo coordinado entre países para lograr una protección de los derechos sin afectar la innovación.

«Lo importante es no perder de vista que esto es una herramienta y todas las herramientas son creadas por humanos, siempre. Y eso es lo que debemos tener en cuenta al establecer los usos éticos. No olvidarlo nunca: la regulación es creada por humanos para evitar lo que los humanos puedan hacer mal al usar las máquinas», añadió Erick Iriarte.