Fátima Toche Vega, socia principal del estudio IALaw informó que hoy, 9 de setiembre de 2025, se ha publicado en el Decreto Supremo N.° 115-2025-PCM, que aprueba el Reglamento de la Ley N.° 31814, «Ley que promueve el uso de la inteligencia artificial en favor del desarrollo económico y social del país».

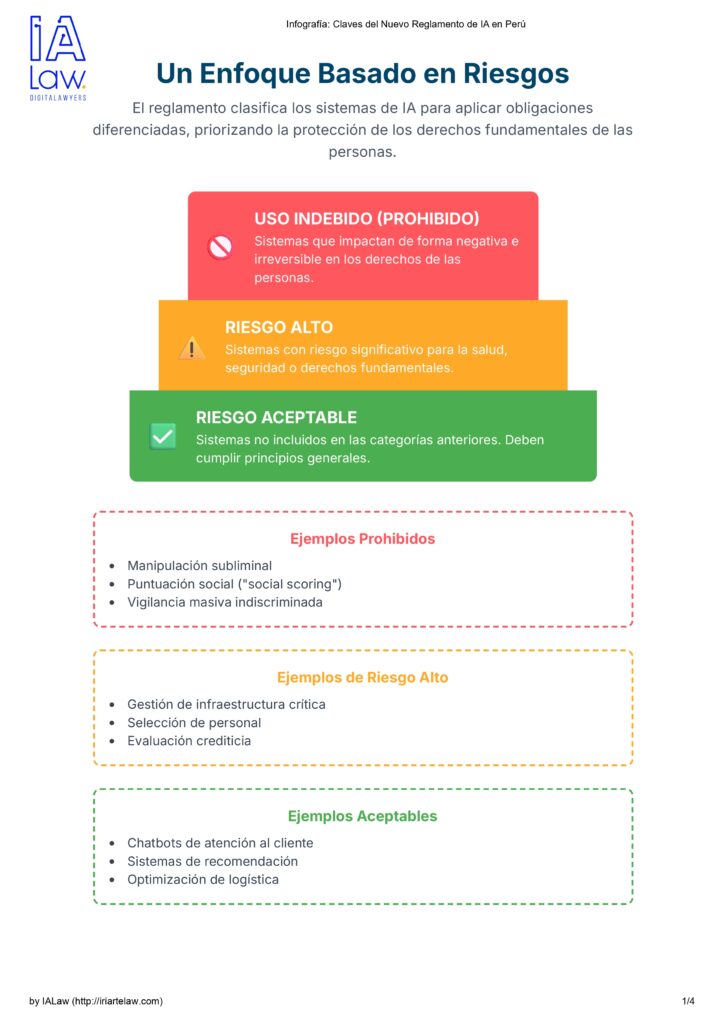

La norma, que establece las disposiciones clave para el desarrollo, implementación y uso de sistemas de Inteligencia Artificial (IA) en Perú, entrará en vigencia a los noventa (90) días hábiles siguientes a su publicación, es decir en diciembre de 2025. Según explicó Toche, el Reglamento clasifica los sistemas basados en IA según su nivel de riesgo, estableciendo obligaciones diferenciadas para cada categoría: uso indebido, de alto riesgo y aceptable.

Estará prohibido el uso de sistemas de IA que impacten de manera negativa e irreversible en los derechos fundamentales. «Esto incluye sistemas con capacidad letal autónoma, vigilancia masiva sin base legal, o aquellos que influyan de manera engañosa en la toma de decisiones de las personas», citó.

De alto riesgo son los sistemas cuyo uso implica un peligro porque atentan contra la vida, la dignidad y los derechos de las personas. Pueden ser utilizados si cumplen con condiciones y controles estrictos. «Se incluyen aquí sistemas para la gestión de activos críticos (energía, salud, banca), evaluación en procesos educativos, selección de personal, y evaluación crediticia, entre otros», detalló.

Todos los demás sistemas de IA, tanto del sector público como privado, se consideran de riesgo aceptable y podrán usarse si cumplen con la normativa vigente y el conjunto de obligaciones y buenas prácticas propuestas en el citado reglamento. En el caso del sector privado se establece que deben tener políticas y protocolos internos para garantizar la seguridad, privacidad, transparencia y rendición de cuentas. Además, se debe fomentar la concientización de los colaboradores sobre los riesgos y el uso seguro, responsable y ético de la IA.

Para el sector público se establecen obligaciones más estrictas para garantizar un uso responsable de la IA. Deberán aprobar una política interna sobre el uso seguro, responsable y ético de la IA, regirse por estándares técnicos (Norma Técnica Peruana NTP-ISO/IEC 42001:2025) de forma obligatoria y el código fuente de los sistemas de IA financiados con fondos públicos deberá publicarse en la Plataforma Nacional de Software Público Peruano.

«Se incluyen aquí sistemas para la gestión de activos críticos (energía, salud, banca), evaluación en procesos educativos, selección de personal, y evaluación crediticia, entre otros».

Fátima Toche Vega, socia principal del estudio IALaw

Si la Secretaría de Gobierno y transformación Digital (SGTD) detecta un incumplimiento por parte de una entidad pública, deberá reportarla a la Contraloría General de la República (CGR) para que esta inicie las acciones correspondientes contra los funcionarios responsables. También actuará cuando la SGTD tome conocimiento de una presunta vulneración a la propiedad intelectual, a la protección de datos personales, o la afectación de otros derechos fundamentales en el ámbito privado.

La SGTD, a través del Centro Nacional de Seguridad Digital, monitoreará de forma preventiva los sistemas de IA de uso indebido y de riesgo alto, explicó la experta. Además, podrá requerir información y remitir recomendaciones o alertas técnicas para evaluar el funcionamiento y los riesgos de dichos sistemas.

El reglamento establece una implementación gradual de algunas obligaciones especiales, como la de transparencia, que van de uno a cuatro años, dependiendo del tamaño y sector en el que opera la organización. Toche recomendó iniciar un diagnóstico interno para identificar y clasificar los sistemas de IA que utilizan o desarrollan, a fin de adecuarse progresivamente a las nuevas obligaciones dentro de los plazos establecidos.